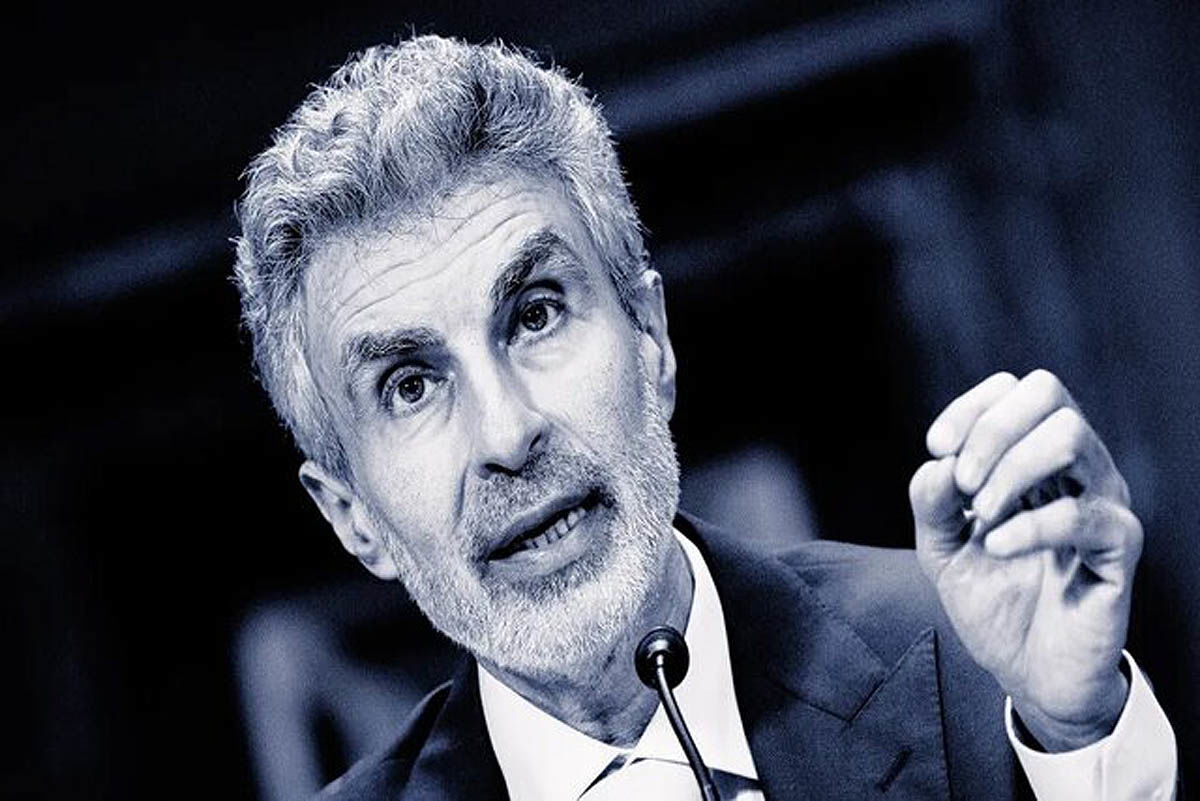

پدرخوانده هوش مصنوعی به کمپین مقابله با فجایع این فناوری پیوست

به نقل از نشریه موسسه MIT هدف این پروژه که Safeguarded AI نام دارد و به معنی «هوش مصنوعی محافظت شده» است، ساخت یک سیستم هوش مصنوعی است که بتواند بررسی کند که آیا سایر سیستمهای هوش مصنوعی مستقر در مناطق حیاتی ایمن هستند یا خیر. بنجیو به عنوان مدیر علمی به این پروژه ملحق میشود و مشاورههای انتقادی و توصیههای علمی را ارائه میدهد. این پروژه که طی چهار سال آینده ۵۹ میلیون پوند اعتبار دریافت خواهد کرد، توسط آژانس تحقیقات و اختراعات پیشرفته بریتانیا (ARIA) تامین مالی میشود که در ژانویه سال گذشته برای سرمایهگذاری در تحقیقات علمی بالقوه تحولآفرین راهاندازی شد.

دیوید دالریمپل، مدیر برنامه هوش مصنوعی محافظت شده در ARIA، میگوید هدف «هوش مصنوعی محافظتشده» ساخت سیستمهای هوش مصنوعی است که میتوانند تضمینهای کمی در مورد تاثیر آنها بر دنیای واقعی ارائه دهند. ایده این است که آزمایش انسانی را با تجزیه و تحلیل ریاضی پتانسیل آسیبرسانی سیستمهای جدید تکمیل کند. هدف این پروژه ساخت مکانیسمهای ایمنی هوش مصنوعی با ترکیب مدلهای علمی جهان است که اساسا شبیهسازیهایی از جهان با اثباتهای ریاضی هستند. این شواهد شامل توضیحاتی درباره کار هوش مصنوعی میشود و انسانها وظیفه دارند بررسی کنند که آیا بررسیهای ایمنی مدل هوش مصنوعی درست است یا خیر. بنجیو میگوید که میخواهد کمک کند تا این اطمینان حاصل شود که سیستمهای هوش مصنوعی آینده نتوانند آسیب جدی وارد کنند. بنجیو میگوید، شرکتهای علم و فناوری راهی برای ارائه تضمینهای ریاضی مبنی بر اینکه سیستمهای هوش مصنوعی طبق برنامهریزی رفتار خواهند کرد، ندارند. او میگوید که این غیرقابل اعتماد بودن میتواند به نتایج فاجعهباری منجر شود. چشمانداز ساخت یک «هوش مصنوعی دروازهبان» است که وظیفه آن درک و کاهش خطرات ایمنی سایر عوامل هوش مصنوعی است. این دروازهبان تضمین میکند که عوامل هوش مصنوعی که در بخشهای پرمخاطره مانند سیستمهای حملونقل یا انرژی کار میکنند، همانطور که ما میخواهیم عمل کنند.